Redacción

Un equipo de ingenieros en computación de la Universidad de Chicago ha desarrollado una herramienta llamada Fawkes, cuyo propósito es confundir a los sistemas de reconocimiento facial al hacer pequeñas modificaciones en las imágenes en línea de las personas, informó el diario The New York Times.

Esta herramienta se podría utilizar de forma masiva como una defensa amplia contra los sistemas de reconocimiento facial que abusan de las millones de imágenes que hay actualmente en Internet; como el caso de Clearview AI, un software usado por autoridades para identificar a personas con base en las fotografías que hay en la red.

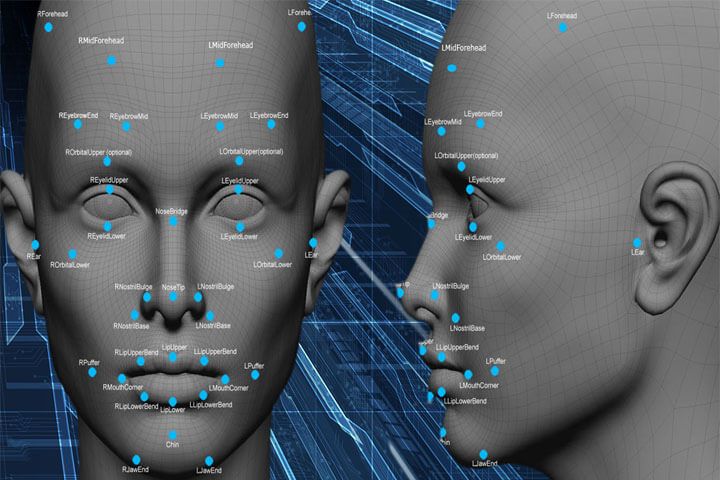

Fawkes camufla las imágenes de estos sistemas mediante la alteración de algunos de los rasgos empleados por los sistemas de reconocimiento facial para identificar a una persona. El software usa un modelo de rostro lo más distinto posible al original desde una base de datos de imágenes de celebridades. Además, los rasgos muchas veces pertenecen a personas que el sistema reconoce como del sexo opuesto.

Una más: Facebook escucha a sus usuarios y paga para transcribir

De esta manera, Fawkes está diseñado para corromper los sistemas de reconocimiento facial a través de “envenenar los datos”. Idealmente, para los creadores, las personas deberían enmascarar todas las imágenes que han subido a Internet.

Sin embargo, la enorme cantidad de imágenes que ya han sido subidas a Internet limita los alcances de estas herramientas. Por esta razón, una de las creadoras de Fawkes considera que se requiere un doble enfoque, que los individuos tengan herramientas tecnológicas y que simultáneamente se creen leyes sobre la privacidad para protegerlos.

Asimismo, para incrementar la efectividad de la herramienta, se requeriría que algunas plataformas que tengan grandes bases de datos con imágenes de personas, como Facebook, implementaran el filtro para realmente prevenir a futuro que plataformas como Clearview exploten las imágenes de las personas.